Со времен древности философы и математики пытались хоть как как то понять и определить смысл этого могучего нашего свойства.

Еще Платон разделял и выделял нелогическое познание,

Декарт, например, утверждал: Под интуицией я разумею не веру в шаткое свидетельство чувств и не обманчивое суждение беспорядочного воображения, но понятие ясного и внимательного ума, настолько простое и отчётливое, что оно не оставляет никакого сомнения в том, что мы мыслим, или, что одно и то же, прочное понятие ясного и внимательного ума, порождаемое лишь естественным светом разума и благодаря своей простоте более достоверное, чем сама дедукция.

Гегель указывал на непосредственное знание,

и даже Фейербах упомянул о чувственности познания!

В данной статье автор попытается провести такое же исследование интуиции, но не человеческой, нам всем знакомой и известной, а определить и показать интуицию у искуственного интеллекта, у нейронной сети.

Итак начнем!

для изучения и препарирования возьмем уже привычный, вдоль и поперек изученный, насквозь понятный пример классика ML, handwritten images MNIST.

И возьмем в дело также всем известный, многократно проверенный и изученный пример сети с сайта keras

https://keras.io/examples/vision/mnist_convnet/

или с Github

https://github.com/keras-team/keras-io/blob/master/examples/vision/mnist_convnet.py

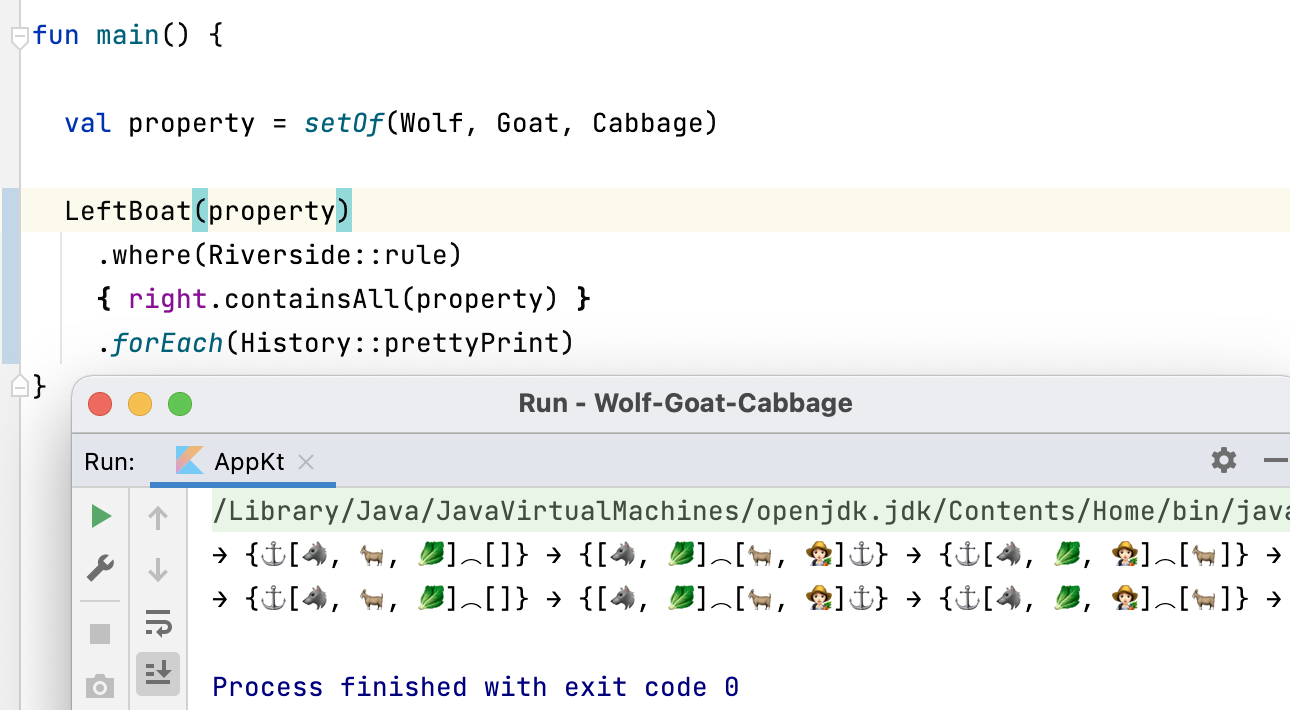

"""Title: Simple MNIST convnetAuthor: [fchollet](http://personeltest.ru/aways/twitter.com/fchollet)Date created: 2015/06/19Last modified: 2020/04/21Description: A simple convnet that achieves ~99% test accuracy on MNIST."""import numpy as npfrom tensorflow import kerasfrom tensorflow.keras import layers# Model / data parametersnum_classes = 10input_shape = (28, 28, 1)# the data, split between train and test sets(x_train, y_train), (x_test, y_test) = keras.datasets.mnist.load_data()# Scale images to the [0, 1] rangex_train = x_train.astype("float32") / 255x_test = x_test.astype("float32") / 255# Make sure images have shape (28, 28, 1)x_train = np.expand_dims(x_train, -1)x_test = np.expand_dims(x_test, -1)print("x_train shape:", x_train.shape)print(x_train.shape[0], "train samples")print(x_test.shape[0], "test samples")# convert class vectors to binary class matricesy_train = keras.utils.to_categorical(y_train, num_classes)y_test = keras.utils.to_categorical(y_test, num_classes)model = keras.Sequential( [ keras.Input(shape=input_shape), layers.Conv2D(32, kernel_size=(3, 3), activation="relu"), layers.MaxPooling2D(pool_size=(2, 2)), layers.Conv2D(64, kernel_size=(3, 3), activation="relu"), layers.MaxPooling2D(pool_size=(2, 2)), layers.Flatten(), layers.Dropout(0.5), layers.Dense(num_classes, activation="softmax"), ])model.summary()batch_size = 512epochs = 15model.compile(loss="categorical_crossentropy", optimizer="adam", metrics=["accuracy"])model.fit(x_train, y_train, batch_size=batch_size, epochs=epochs, verbose=2)

изменим только всего лишь один параметр batch_size = 512. Благо карта позволяет.

Проверим результат

score = model.evaluate(x_test, y_test, verbose=0)print("Test loss:", score[0])print("Test accuracy:", score[1])Test loss: 0.028873076662421227Test accuracy: 0.9898999929428101

так себе результат, бывает и лучше.

И вот теперь, когда на руках не очень хорошо обученая сеть и слабенький результат, попробуем применить интуицию или то, что автор называет интуицией.

Выберем, конечно же интуитивно, некоторое множество из тестовых картинок и проверим, как на этих картинках работает наша сеть

pred = model.predict(x_test)idx = np.argwhere( np.array( [ pred[x, np.argsort(pred, axis=1)[x, -1]] - pred[x, np.argsort(pred, axis=1)[x, -2]] for x in range(pred.shape[0]) ] ) > 0.999).reshape(-1)print(idx.shape)score = model.evaluate(x_test[idx], y_test[idx], verbose=0)print("Test loss:", score[0])print("Test accuracy:", score[1])

Оказывается мы выбрали только те картинки из тестового множества где сеть дает 100% результат!

Test loss: 0.00011477641965029761Test accuracy: 1.0

Обратите внимание, мы учили сеть на TRAIN, а точки интуитивно выбрали из TEST.

Никакого подвоха и сеть не могла подсмотреть.

Но на выбранном множестве картинок результат с accuracy: 1.0

Не буду сейчас обсуждать практическую или теоретическую часть описанного выше явления или, если угодно, свойства сети,

Но факт есть и ничем и никак не обоснованное решение позволяет выбрать точно распознаваемые картинки и сосредоточиться на распознавании оставшихся.

Их кстати меньше половины.

Можно конечно внести изменения и если снизить требования к интуиции ну хоть до 0.99 то мы пропустим только одну или две картинки, но выберем около 9500.

Оставшиеся 500 можно изучить глазамии и сделать тонкую настройку сети и подобающую аугментацию.

Уверен, что правильное применение интуиции AI в таком тонком и сложном вопросе как машинное обучение и искусственный интеллект, несомненно добавит точности вашим сетям.